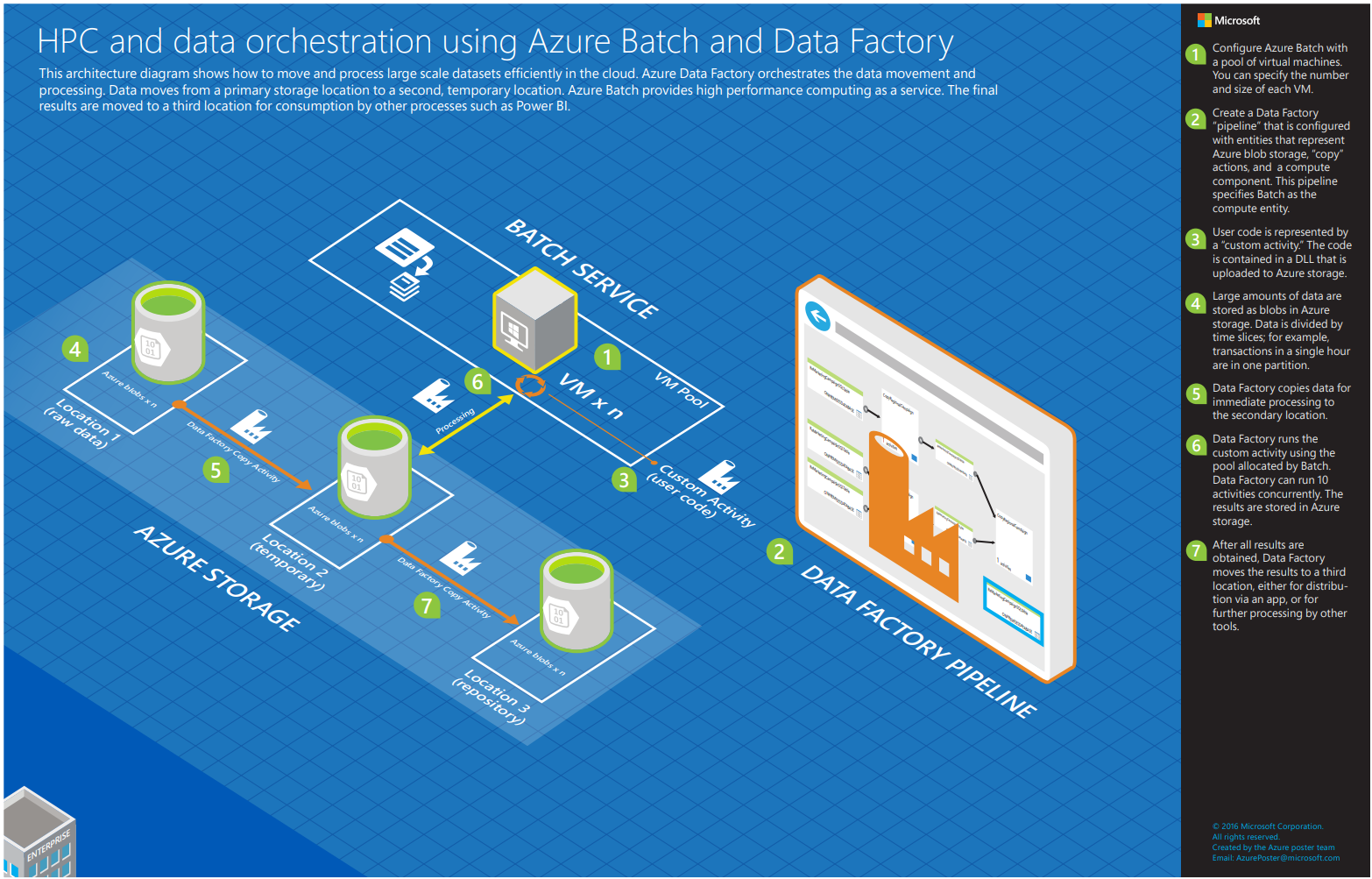

使用数据工厂和批处理服务处理大规模数据集 - Azure Data Factory | Batch 数据处理服务

随着数据量的爆炸式增长,企业和组织需要高效的工具来处理和管理大规模数据集。Azure Data Factory(ADF)和 Azure Batch 是微软云平台上两个强大的服务,它们可以帮助用户构建和管理数据处理流程,特别是针对大规模数据集的批处理任务。本文将介绍如何使用这两个服务来高效处理大规模数据集。

1. Azure Data Factory 概述

Azure Data Factory 是一种云数据集成服务,它允许用户创建、调度和管理数据工作流。通过 ADF,用户可以轻松地从各种数据源(如本地数据库、云存储、API 等)提取数据,进行转换和处理,然后加载到目标系统(如 Azure SQL 数据库、数据湖或 BI 工具)。ADF 的核心功能包括:

- 数据移动:支持多种数据源的连接和数据传输。

- 数据转换:通过集成 Azure Databricks、HDInsight 或其他计算服务,实现数据清洗、聚合和转换。

- 工作流编排:使用可视化界面或代码定义复杂的管道,并设置触发器和依赖关系。

对于大规模数据集,ADF 提供可扩展的解决方案,能够并行处理大量数据,同时优化成本和性能。

2. Azure Batch 服务概述

Azure Batch 是一种云批处理服务,专为运行大规模并行和高性能计算(HPC)应用程序而设计。它允许用户在托管虚拟机池上执行批处理作业,自动管理资源分配、任务调度和扩展。Batch 的核心优势包括:

- 资源管理:自动创建和管理虚拟机池,根据负载动态调整规模。

- 任务并行化:将大型工作负载分解为多个小任务,并行运行以提高效率。

- 成本优化:支持按需或低优先级虚拟机,降低计算成本。

Batch 特别适合处理计算密集型任务,例如图像处理、科学模拟或大数据分析,这些任务通常涉及大规模数据集的批处理。

3. 结合使用 ADF 和 Batch 处理大规模数据集

在许多场景中,ADF 和 Batch 可以协同工作,以构建端到端的数据处理解决方案。以下是一个典型的流程示例:

- 数据提取:使用 ADF 从多个源(如 Azure Blob 存储或本地数据库)提取大规模数据集。

- 数据预处理:ADF 将数据传递给 Batch 服务,Batch 在虚拟机池上并行运行自定义脚本或应用程序,进行数据清洗、转换或分析。

- 结果存储:处理后的数据通过 ADF 加载到目标系统,如数据仓库或数据湖,供进一步使用。

这种组合的优势包括:

- 可扩展性:Batch 可以根据数据量自动扩展计算资源,而 ADF 确保数据管道的可靠性。

- 灵活性:用户可以使用熟悉的工具(如 Python、R 或 .NET)编写批处理逻辑,并通过 ADF 进行编排。

- 成本效率:通过仅在使用时分配资源,避免过度配置,降低总体拥有成本。

4. 实际应用案例

假设一个电商公司需要每天处理数百万条交易记录,以生成销售报告和客户行为分析。使用 ADF 和 Batch 的步骤如下:

- ADF 从交易数据库和日志文件中提取数据。

- Batch 运行自定义算法,对数据进行聚合和异常检测。

- ADF 将结果加载到 Power BI 或 Azure Synapse Analytics,供业务团队使用。

这种方法不仅缩短了处理时间,还提高了数据的准确性和可用性。

5. 最佳实践和注意事项

在使用 ADF 和 Batch 时,建议遵循以下最佳实践:

- 监控和日志记录:利用 Azure Monitor 和 Application Insights 跟踪管道性能和错误。

- 错误处理:在 ADF 管道中设置重试机制和警报,确保任务失败时能及时处理。

- 安全性和合规性:使用 Azure Key Vault 管理凭据,并确保数据传输和存储符合行业标准。

Azure Data Factory 和 Batch 服务为处理大规模数据集提供了强大而灵活的解决方案。通过结合使用这两个服务,企业可以高效地管理数据工作流,实现从数据提取到洞察的端到端自动化。无论您是处理日志数据、执行机器学习任务,还是构建报告系统,这些工具都能帮助您在云环境中实现规模化数据处理。

如若转载,请注明出处:http://www.baiying101.com/product/14.html

更新时间:2025-11-29 17:35:22